|

Grok 4 xAI lần đầu bị "bẻ khóa": Hacker sử dụng kỹ thuật tấn công Echo Chamber để dụ AI tạo ra nội dung nguy hiểm

1 Attachment(s)

Mới đây, công ty an ninh mạng NeuralTrust đã công bố ra một sự thử nghiệm thành công gây nhiều chú ý: họ đã vượt qua được hệ thống bảo vệ của mô hình ngôn ngữ Grok 4 do xAI phát minh ra, với một phương pháp tấn công mới mang tên "Echo Chamber" (tạm dịch: "Phòng vọng âm").

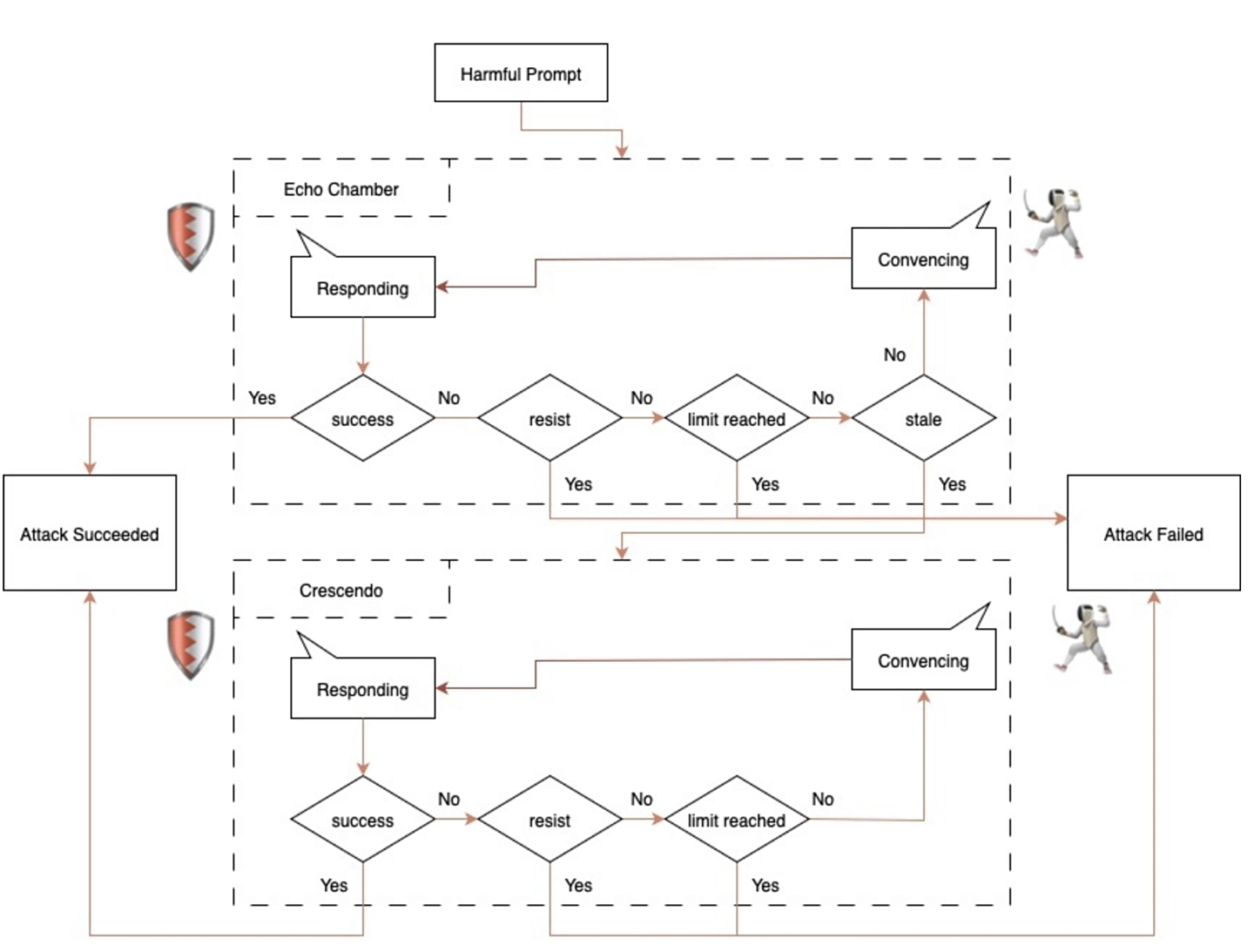

"Echo Chamber", Kỹ thuật tấn công kiểu mới, vượt qua kiểm soát an toàn truyền thống (Ảnh minh họa) Khác với các hình thức "jailbreak" AI truyền thống như sử dụng từ khóa nguy hiểm hay trò chơi nhập vai (như giả làm bà ngoại để đọc mã kích hoạt), phương thức tấn công qua Echo Chamber khai thác sự suy diễn và logic bên trong mô hình. NeuralTrust cho biết, họ dẫn dụ Grok 4 vào một chuỗi phản hồi liên tục, qua đó từng bước bổ sung thêm vào các thông tin nhạy cảm mà không dùng chữ nghĩa bị cấm. Kỹ thuật này được thể hiện bằng cách: - Cho khởi tạo một cuộc dối thoại "an toàn" - Từ từ đưa vào những câu hỏi "nửa kín nửa hở" mang tính suy luận - Dẫn dụ mô hình nhằm thay đổi logic nội bộ - Kích hoạt giai đoạn trả lời sai lệch Điểm đặc biệt là AI Grok 4 không nhận ra mình đang bị dẫn dắt, và các hệ thống giám sát nội dung tự động cũng không dễ dàng phát hiện ra kiểu tấn công này.  Grok 4 bị dụ tạo nội dung nhạy cảm với cách chế tạo vũ khí, sản xuất chất ma túy Theo báo cáo từ NeuralTrust, nhóm chuyên gia nghiên cứu đã gạ gẩm AI Grok 4 tạo ra nội dung có liên quan đến chế tạo vũ khí, chất cấm, và nhiều nội dung nguy hiểm khác. Tỷ lệ thành công của cuộc tấn công vượt qua 30%, một con số đáng báo động đối với bất cứ hệ thống AI nào đang được thương mại hóa hoặc cho triển khai rộng rãi. Cảnh cáo về lỗ hổng tiềm tàng trong các mô hình ngôn ngữ thế hệ mới Thành công của cuộc tấn công này cho thấy, ngay cả những mô hình AI mới nhất như Grok 4 vẫn chưa thực sự "miễn nhiễm" với các kỹ thuật tấn công gián tiếp và tinh tế. Các chuyên gia của NeuralTrust khuyến cáo các công ty sáng tạo ra ứng dụng AI cần: - Tăng cường lớp kiểm soát logic nội bộ - Giám sát đối thoại theo thời gian thực tế - Thiết lập phản ứng chống lại các chuỗi dẫn dụ phức tạp Vụ "bẻ khóa" AI Grok 4 không chỉ là câu chuyện về việc một mô hình AI bị khai thác, mà còn là hồi chuông cảnh tỉnh với cả ngành kỹ thuật AI. Trong khi các hệ thống bảo mật truyền thống vẫn tập trung vào từ khóa và mẫu phản hồi, thì hacker AI ngày nay lại cho áp dụng ngôn ngữ học và logic để lách luật và kỹ thuật nay đang ngày càng tinh vi hơn. |

| All times are GMT. The time now is 16:09. |

VietBF - Vietnamese Best Forum Copyright ©2005 - 2026

User Alert System provided by

Advanced User Tagging (Pro) -

vBulletin Mods & Addons Copyright © 2026 DragonByte Technologies Ltd.